在未成年人网络保护已成为全球共同治理议题的背景下,我国近期由网信办、广电总局等八部门联合发布了《可能影响未成年人身心健康的网络信息分类办法》。为系统把握国际经验与趋势,本文梳理了澳大利亚、欧盟、美国、英国及东亚部分国家与地区在未成年人网络保护方面的主要政策举措,以期为我国相关工作的开展提供参考与借鉴。

一、澳大利亚未成年人社交媒体禁令的出台背景、主要规定和落实挑战

(一)禁令出台是公共健康焦虑、政治博弈与社会运动共振的产物

2024年初,美国心理学家乔纳森·海特在《焦虑的一代》一书中,将过去十年全球青少年焦虑、抑郁、自残呈上升趋势的现象,与智能手机和社交媒体的普及深度关联,呼吁禁止青少年使用社交媒体,直接推动了澳大利亚各州政府将社交媒体监管迅速纳入政治议程。与此同时,澳大利亚的传媒集团发起的“让孩子做孩子”(Let Them Be Kids)运动,通过大量社论向议会施压,指责科技巨头“偷走童年”。在2024年11月极短的立法窗口期内,尽管收到1.5万份意见书,澳大利亚议会两院仍以跨党派的压倒性多数通过了法案。

(二)禁令条例采取“平台全责”原则

禁令要求,自2025年12月10日起,全面禁止16岁以下未成年人在TikTok、Instagram、Snapchat、YouTube、Facebook、X等主流社交媒体平台注册或持有账户。该条例将识别和拦截未成年用户的首要及主要法律责任完全置于平台一方,若平台未能采取“合理措施”履行此义务,将面临最高达数千万澳元的巨额罚款。该法明确豁免了未成年人用户及其监护人的法律责任,即处罚对象仅为平台,这在一定程度上试图缓解对家庭端的直接冲击,但也将全部管理压力转移给了社交媒体。此外,监管机构eSafety委员会被赋予了巨大的自由裁量权,可以根据平台的互动性、用户生成内容属性及算法特征,动态更新受限名单,目前已涵盖Facebook、TikTok、Reddit、YouTube等十余个核心平台。

(三)澳大利亚政府将该禁令定位为“公共健康干预”

澳大利亚该禁令出台基于三项核心理由。第一,风险暴露具有普遍性。数据显示,该国10至15岁儿童社交媒体使用率高达96%,其中约70%曾接触过仇恨言论、网络暴力等有害内容。第二,心理健康危机与社交媒体增长轨迹高度重合。自2010年以来,青少年抑郁、焦虑等问题显著增加,其趋势与社交媒体的普及曲线高度同步,在女孩等群体中尤为突出。第三,存在神经发育与产品设计的结构性冲突。研究表明,负责决策控制的大脑前额叶皮层约25岁才发育成熟,而社交媒体通过“无限滚动”等算法机制构建的即时奖励系统,极易与青少年的不成熟自控力发生冲突,诱发过度使用。

(四)禁令面临技术、行为与文化层面多重挑战

首先,技术防线存在漏洞。现行年龄验证系统(如面部识别)可被照片、面具轻易绕过,且VPN改换地理位置、使用境外邮箱等规避方法已在青少年中广泛流传。其次,用户行为将发生适应性迁移。禁令可能迫使青少年从受监管的主流平台,转向未被列入清单的小众应用、加密通讯工具或游戏内置聊天系统,甚至进入监管更薄弱的“暗网”式空间,反而暴露于更高风险中。最后,家庭配合度构成关键阻力。约三分之一家长明确表示愿意协助子女规避禁令,理由包括维护社交需求、不认同粗暴断网方式、相信自身监督更有效等。批评者警告,若处理不当,该政策非但无法实现保护初衷,反而可能将未成年人从具备基本安全措施的平台,“驱赶”至更不可控的阴影地带,最终放大安全风险。

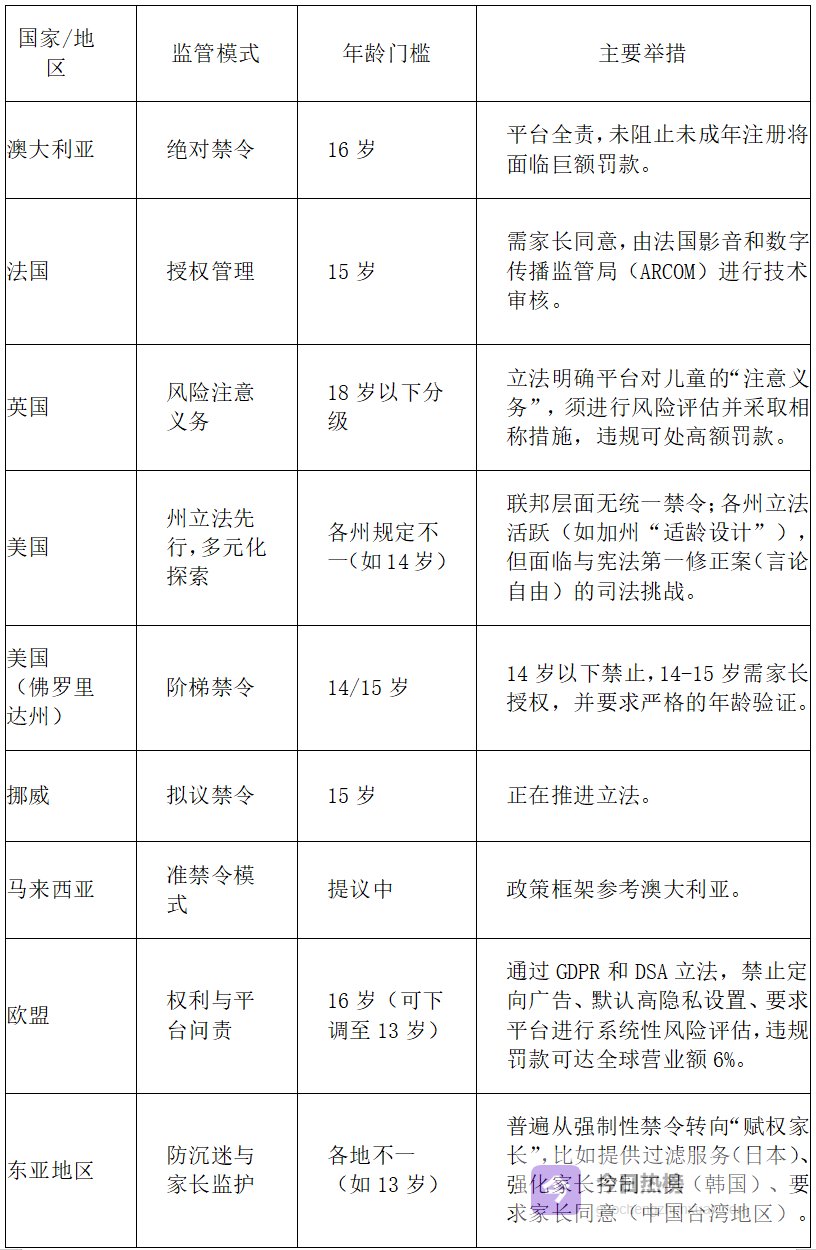

二、主要国家和地区未成年人社交媒体治理方式

尽管澳大利亚的全面禁令较为极端,但全球在未成年人网络治理上正形成以“设定年龄门槛、压实平台责任、采用技术工具、推动多元共治”为核心的政策共识。基于此共识,各国和地区在实践中形成了不同的治理模式。

(一)欧盟实施“基于权利与平台问责”的强监管

欧盟通过《通用数据保护条例》(GDPR)和《数字服务法》(DSA)构建了全球最严格的未成年人数字保护框架之一。GDPR将16岁(成员国可下调至13岁)设定为未经父母同意处理个人数据的法定年龄。DSA则要求大型在线平台(VLOPs)采取特定措施保护未成年人,包括禁止基于精准画像的定向广告、提供更强隐私设置、默认启用高风险保护模式,并系统性评估和缓解其服务对未成年人的潜在风险。该模式的特点是将未成年人保护嵌入平台的核心运营义务,通过高额罚款(可达全球营业额6%)确保合规,强调风险评估与过程性监管。

(二)美国州立法先行,监管方式多元

美国内部围绕此类法律与宪法第一修正案(言论自由)的冲突争议激烈,多部法律正面临司法挑战。美国联邦层面尚未出台统一的社交媒体年龄限制禁令,但各州立法活跃。例如,佛罗里达州法律禁止14岁以下儿童拥有社交媒体账户,14-15岁需父母同意;得克萨斯州要求未成年用户注册需获父母许可;加利福尼亚州通过《适龄设计规范法案》,要求在线服务在设计之初即将未成年人最佳利益置于首位,默认实施高隐私保护设置。

(三)英国实施强监管和分级监管,明确平台责任

英国《网络安全法》(Online Safety Act)将保护儿童置于核心,确立了平台对用户的“注意义务”。法律要求平台必须采取相称的措施,预防和减少对儿童合法权益的损害,包括非法内容接触、欺凌、色情内容、自残鼓励等;违规企业最高罚1800万英镑或全球营业额10%,相关高管可能承担刑事责任。英国通信管理局(Ofcom)有权对违规平台处以巨额罚款甚至封锁服务。英国信息专员办公室(ICO)发布的《适龄设计规范》(Age-Appropriate Design Code),将未成年人划分为0-5岁、6-9岁、10-12岁、13-15岁、16-17岁五个年龄层,并针对不同年龄段提出差异化保护措施,包括默认设置儿童友好模式、限制数据收集范围、提供易于理解的隐私政策及建立有效的年龄验证机制。

(四)东亚地区强调家长监护责任与选择权

韩国曾实施引发广泛关注的“游戏宵禁法”(灰姑娘法),后因执行困难与副作用于2021年废除,转向强化家长控制工具与选择性同意制。日本通过行业自律和《青少年网络环境整治法》,要求手机运营商默认提供过滤服务,由监护人选择是否启用。部分地区还从立法层面限制使用时长,如2025年10月,日本丰明市通过要求市民非工作/学习手机使用每日不超过2小时(小学生晚9点后、中学生晚10点后停用)。

表部分国家未成年人社交媒体监管模式与主要内容

(作者单位:国家广播电视总局发展研究中心赵京文)

—END—

监 制:史 杰

轮值主编:彭 锦

责任编辑:沈雅婷

后期编辑:郭 钰

原创文章,作者:朱雅琪,如若转载,请注明出处:http://m.gaochengzhenxuan.com/news/931.html