SambaNova发布了其最新芯片SN50,声称其速度比英伟达Blackwell快五倍,吞吐量高三倍,足以为超过10万亿参数的智能体AI模型提供动力。该公司还宣布将SN50部署到日本软银,与英特尔建立新的合作伙伴关系,以及完成3.5亿美元融资轮。

背景与架构

AI繁荣及其引发的数据处理无限需求使SambaNova成为新兴芯片制造商之一。该公司开发了其可重构数据单元(RDU)架构,该架构实现自定义处理管道,数据在其中流经完整计算图,以解决传统CPU和GPU使用的指令集架构(ISA)中遇到的数据移动低效问题。

SN50芯片特性

与SN40一样,SN50采用分层内存架构,结合了64GB高带宽内存(HBM)、432MB静态随机存取存储器(SRAM)和256GB至2TB的DDR5。SambaNova表示,这种内存架构使其能够托管最大的AI模型,包括高达10万亿参数的模型。

"驻留在HBM和SRAM中的模型可以在几毫秒内进行数据交换,这是智能体工作负载在多个模型之间频繁切换所必需的能力。"该公司在一篇博客文章中写道。

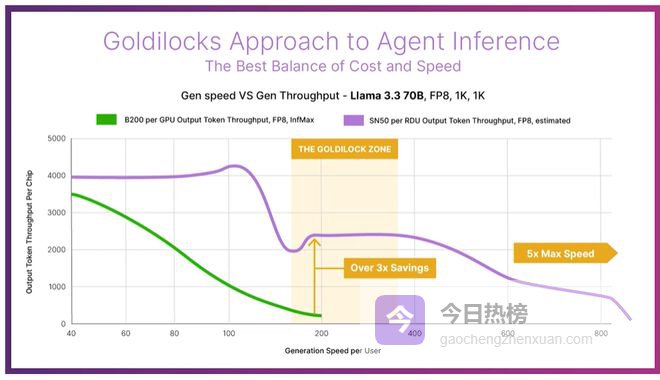

SambaNova表示,与SN40相比,SN50每个加速器提供五倍的计算能力和四倍的网络带宽。该公司表示,内部基准测试显示,与英伟达的Blackwell B200 GPU相比,SN50在运行像Meta的Llama 3.3 70B等模型的智能体推理工作负载时提供5倍的最大速度和超过3倍的吞吐量。

扩展与部署

SambaNova将芯片预先配置在名为SambaRacks的机架中销售,每个机架最多可容纳16个独立SN50。该公司支持将其SambaRacks向外扩展,以支持通过每秒多T字节带宽连接最多256个SN50集群。每个SambaRack平均消耗20kW电力,这使其能够使用风冷而非液冷。

专注AI推理

AI推理工作负载是SambaNova及其芯片的目标,这一原则在SN50上没有改变。该公司表示,其在内存中缓存输入令牌(Token)的能力减少了相对于主流GPU架构的首令牌时间(TTFT)。它还声称可以在内存中保持多个AI模型,并以比英伟达GPU所需更少时间进行数据交换。

客户与合作

SambaNova表示,软银将是首家部署SN50的公司。该日本公司将在其下一代AI数据中心部署SN50。该公司还宣布与英特尔的新合作,据报道英特尔曾在一月份尝试以16亿美元收购SambaNova。而当下,英特尔是SambaNova价值3.5亿美元的E轮融资的参与者,SambaNova表示将用这笔资金扩大制造和云能力。

展望未来

"AI不再是构建最大模型的竞赛。"SambaNova联合创始人兼首席执行官Rodrigo Liang在新闻稿中说。"凭借SN50和我们与英特尔的深度合作,真正的竞赛是谁能够用能够即时回答、从不卡顿、且成本使AI从实验转变为云端最盈利引擎的智能体点亮整个数据中心。"

原创文章,作者:徐梓涵,如若转载,请注明出处:http://m.gaochengzhenxuan.com/news/8707.html